NVIDIA Blackwell đang mở ra bước ngoặt mới cho công nghệ GPU, đặc biệt trong lĩnh vực AI và điện toán hiệu năng cao (HPC). Với kiến trúc tiên tiến cùng khả năng mở rộng vượt trội, Blackwell hứa hẹn thay đổi cách doanh nghiệp xây dựng và tối ưu hạ tầng AI quy mô lớn. Trong bài viết này, VinaHost sẽ giúp bạn tìm hiểu chi tiết về kiến trúc NVIDIA Blackwell, tính năng và thông số kỹ thuật nổi bật của GPU GB200 NVL72.

NVIDIA Blackwell là kiến trúc GPU thế hệ mới nhất, được thiết kế để xử lý AI tạo sinh (Generative AI) và mô hình ngôn ngữ lớn (LLM) với quy mô hàng nghìn tỷ tham số. GPU này nổi bật với 208 tỷ transistor, thiết kế chiplet hai die kết nối NV-HBI 10 TB/s và tiến trình TSMC 4NP tùy chỉnh, mang lại hiệu suất vượt trội và khả năng mở rộng tối đa.

Những điểm nổi bật ✅

Hiệu năng AI cực mạnh: Transformer Engine và Ultra Tensor Cores giúp tăng tốc huấn luyện và suy luận LLM, đồng thời hỗ trợ định dạng FP4 để tối ưu bộ nhớ.

Bảo mật & độ tin cậy: TEE-I/O, RAS Engine và Decompression Engine bảo vệ dữ liệu nhạy cảm và giảm thời gian xử lý khối lượng dữ liệu lớn.

Hệ thống mạnh nhất: GB200 NVL72 kết hợp 72 GPU Blackwell và 36 CPU Grace, mang lại sức mạnh tối đa cho AI và HPC.

Nếu bạn muốn tìm hiểu chi tiết về kiến trúc, công nghệ AI và sản phẩm Blackwell, cùng khám phá từng phần bên dưới để thấy vì sao NVIDIA Blackwell đang dẫn đầu kỷ nguyên AI hiện đại! 🚀

1. Giới thiệu Kiến trúc Blackwell

1.1. Blackwell là gì?

NVIDIA Blackwell là kiến trúc GPU thế hệ mới nhất của NVIDIA, chính thức ra mắt tại sự kiện GTC 2024 ngày 18/3/2024. Đây là bước tiến lớn tiếp theo sau Hopper, được tạo ra nhằm đáp ứng nhu cầu tính toán ngày càng tăng của AI tạo sinh (Generative AI) và các mô hình ngôn ngữ lớn (LLM) với quy mô hàng nghìn tỷ tham số.

Kiến trúc NVIDIA Blackwell được đặt tên để vinh danh David Harold Blackwell – nhà toán học và thống kê học nổi tiếng người Mỹ, người có đóng góp lớn trong lý thuyết trò chơi, lý thuyết xác suất và thống kê hiện đại. Mục tiêu chính của kiến trúc NVIDIA Blackwell là:

- Đẩy mạnh hiệu năng cho AI tạo sinh và mô hình ngôn ngữ lớn, giúp huấn luyện và suy luận các mô hình khổng lồ nhanh chóng và chính xác.

- Tối ưu hóa nền tảng tính toán, giảm chi phí vận hành khi xử lý khối lượng dữ liệu lớn.

- Cung cấp một GPU đủ mạnh để đáp ứng các tác vụ AI phức tạp, từ nghiên cứu học sâu đến triển khai ở quy mô doanh nghiệp.

1.2. Nền tảng cốt lõi: Chiplet và 208 Tỷ Transistor

Kiến trúc Blackwell được xây dựng trên nền tảng phần cứng hoàn toàn mới, tập trung vào việc mở rộng sức mạnh tính toán và tối ưu hiệu suất cho AI hiện đại. Những điểm cốt lõi của nền tảng này bao gồm:

- GPU lớn nhất từ trước đến nay của NVIDIA: NVIDIA Blackwell sở hữu tới 208 tỷ transistor, nhiều hơn khoảng 2,5 lần so với kiến trúc Hopper, cho phép xử lý các tác vụ AI và HPC cực kỳ phức tạp.

- Quy trình sản xuất TSMC 4NP tùy chỉnh: NVIDIA hợp tác cùng TSMC để sử dụng tiến trình 4NP được tối ưu riêng, giúp tăng hiệu năng đồng thời cải thiện hiệu suất trên mỗi watt, giảm tiêu thụ điện năng khi vận hành.

- Thiết kế chiplet hiện đại: Thay vì một chip đơn, NVIDIA Blackwell kết hợp hai chip lớn lại với nhau để tạo thành một GPU thống nhất, giúp vượt qua giới hạn vật lý của khuôn chip truyền thống.

- Kết nối tốc độ siêu cao NV-HBI: Hai chip được liên kết thông qua giao tiếp NV-HBI với băng thông lên đến 10 TB/s, đảm bảo dữ liệu được truyền tải nhanh và liền mạch, gần như hoạt động như một GPU duy nhất.

Nhờ sự kết hợp giữa mật độ transistor rất lớn, quy trình sản xuất TSMC 4NP tùy chỉnh và thiết kế chiplet hiện đại, NVIDIA Blackwell tạo ra một nền tảng GPU mạnh mẽ nhưng vẫn linh hoạt.

2. Blackwell sở hữu công nghệ được phát triển để xử lý tác vụ AI

Để đáp ứng yêu cầu ngày càng cao của AI tạo sinh và các mô hình ngôn ngữ lớn, NVIDIA Blackwell được trang bị nhiều công nghệ chuyên biệt nhằm tăng tốc cả quá trình huấn luyện lẫn suy luận AI.

2.1. Transformer Engine

Transformer Engine là thành phần cốt lõi trong kiến trúc NVIDIA Blackwell, được thiết kế chuyên biệt để tối ưu cho các mô hình AI dựa trên kiến trúc Transformer như LLM và MoE.

- Tác dụng chính: Transformer Engine giúp tăng tốc cả quá trình huấn luyện (training) và suy luận (inference). Các mô hình Transformer thường yêu cầu nhiều phép tính ma trận phức tạp; thành phần này được thiết kế để xử lý các phép toán đó hiệu quả hơn. Nhờ vậy, thời gian huấn luyện có thể được rút ngắn và tốc độ phản hồi khi triển khai thực tế cũng được cải thiện.

- Điểm cải tiến quan trọng – hỗ trợ FP4: Blackwell bổ sung định dạng số FP4 (4-bit floating point). Việc sử dụng độ chính xác thấp hơn giúp giảm lượng dữ liệu cần xử lý và giảm yêu cầu bộ nhớ, trong khi vẫn duy trì mức độ chính xác phù hợp cho nhiều tác vụ AI. Điều này giúp hệ thống vận hành hiệu quả hơn về tài nguyên, đặc biệt khi làm việc với các mô hình quy mô lớn.

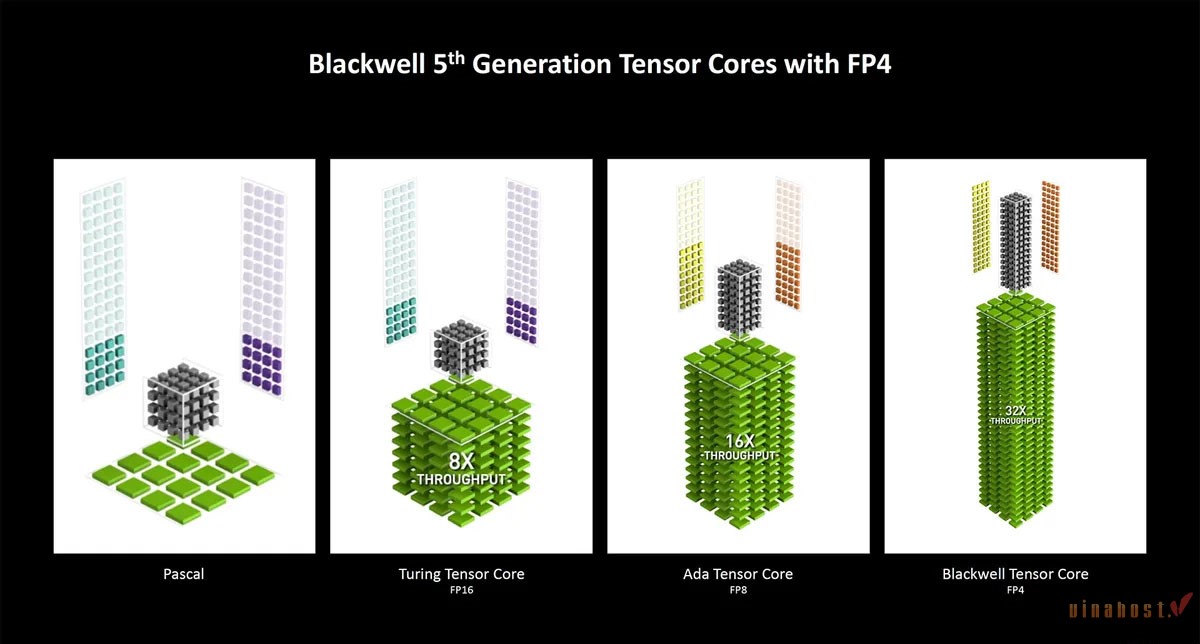

2.2. Lõi Tensor Core

Tensor Core là đơn vị tính toán chuyên biệt trong kiến trúc NVIDIA Blackwell, được tối ưu cho các phép toán ma trận và tensor – nền tảng của hầu hết mô hình học sâu.

- Tác dụng chính: Tensor Core xử lý các phép nhân ma trận kích thước lớn với hiệu suất cao hơn so với CUDA Core thông thường. Điều này giúp tăng tốc đáng kể quá trình huấn luyện và suy luận của các mô hình AI, đặc biệt là những mô hình có quy mô hàng tỷ tham số.

- Blackwell Ultra Tensor Cores: Trên Blackwell, phiên bản Ultra Tensor Core được cải tiến để tăng tốc lớp attention lên gấp 2 lần so với GPU Blackwell tiêu chuẩn.

ℹ️ Attention là thành phần tiêu tốn nhiều tài nguyên nhất trong mô hình Transformer, vì vậy việc tăng tốc lớp này giúp cải thiện thông lượng tổng thể và giảm độ trễ khi xử lý ngữ cảnh dài.

2.3. NVLink Thế hệ thứ năm

NVLink thế hệ thứ năm trên kiến trúc NVIDIA Blackwell là công nghệ kết nối tốc độ cao giữa các GPU, cho phép nhiều GPU hoạt động như một hệ thống thống nhất.

- Băng thông: Mỗi GPU Blackwell hỗ trợ tổng băng thông NVLink lên tới 1.8 TB/s, tương đương 50 GB/s cho mỗi liên kết. Mức băng thông này giúp giảm đáng kể độ trễ khi truyền dữ liệu giữa các GPU, đặc biệt quan trọng trong huấn luyện mô hình lớn.

- Khả năng mở rộng: Hệ thống có thể kết nối tới 576 GPU và mở rộng ra ngoài phạm vi một máy chủ đơn lẻ. Điều này cho phép xây dựng các cụm tính toán AI quy mô rất lớn mà vẫn duy trì khả năng giao tiếp hiệu quả giữa các GPU.

- NVLink Switch và cấu hình NVL72: Thông qua NVLink Switch, hệ thống có thể cung cấp tổng băng thông lên tới 130 TB/s trong miền 72 GPU (NVL72). Kiến trúc này giúp các GPU trao đổi dữ liệu trực tiếp với nhau ở tốc độ cao, thay vì phụ thuộc vào CPU hoặc mạng truyền thống.

2.4. Decompression Engine

Bên cạnh khả năng mở rộng và kết nối GPU, một yếu tố quan trọng khác trong hệ thống AI là tốc độ xử lý dữ liệu đầu vào. Đây là vai trò của Decompression Engine trên NVIDIA Blackwell.

Thay vì để CPU giải nén dữ liệu rồi mới chuyển sang GPU, Blackwell cho phép thực hiện việc này trực tiếp trên GPU với tốc độ lên tới 800 GB/s – nhanh hơn khoảng 18 lần so với xử lý bằng CPU.

Điều này giúp dữ liệu được đưa vào mô hình nhanh hơn, giảm tình trạng nghẽn cổ chai giữa CPU và GPU, đặc biệt khi làm việc với tập dữ liệu lớn hoặc các mô hình AI quy mô lớn.

3. Kiến trúc Hooper hỗ trợ Bảo mật Dữ liệu AI

Bên cạnh hiệu năng tính toán, các hệ thống AI quy mô lớn còn yêu cầu cơ chế bảo mật dữ liệu và khả năng vận hành ổn định. Kiến trúc NVIDIA Hopper được thiết kế để đáp ứng những yêu cầu này, đặc biệt trong môi trường trung tâm dữ liệu và doanh nghiệp.

3.1 Khả năng TEE-I/O (Trusted Execution Environments)

TEE-I/O là cơ chế bảo mật được tích hợp trong kiến trúc NVIDIA Hopper nhằm bảo vệ dữ liệu trong suốt quá trình xử lý trên GPU.

Mục đích chính: Bảo vệ dữ liệu nhạy cảm và tài sản trí tuệ (IP) của mô hình AI mà không làm giảm thông lượng hệ thống. Cụ thể, TEE-I/O giúp:

- Ngăn chặn truy cập trái phép vào dữ liệu đang được xử lý trên GPU

- Bảo vệ trọng số và thuật toán của mô hình khi triển khai trên hạ tầng dùng chung hoặc môi trường đám mây

- Duy trì hiệu suất xử lý cao, đảm bảo các workload AI vẫn vận hành ổn định và nhanh chóng

3.2 RAS Engine

RAS Engine (Reliability, Availability, Serviceability) là cơ chế đảm bảo độ tin cậy và khả năng vận hành liên tục của hệ thống GPU trên kiến trúc NVIDIA Hopper.

Mục đích chính: Đảm bảo khả năng phục hồi thông minh bằng cách theo dõi sức khỏe phần cứng và phần mềm, từ đó giảm thiểu thời gian ngừng hoạt động (downtime). Cụ thể, RAS Engine:

- Giám sát liên tục trạng thái của GPU và các thành phần liên quan

- Phát hiện sớm lỗi hoặc dấu hiệu bất thường

- Hỗ trợ cảnh báo và xử lý để hạn chế gián đoạn hệ thống

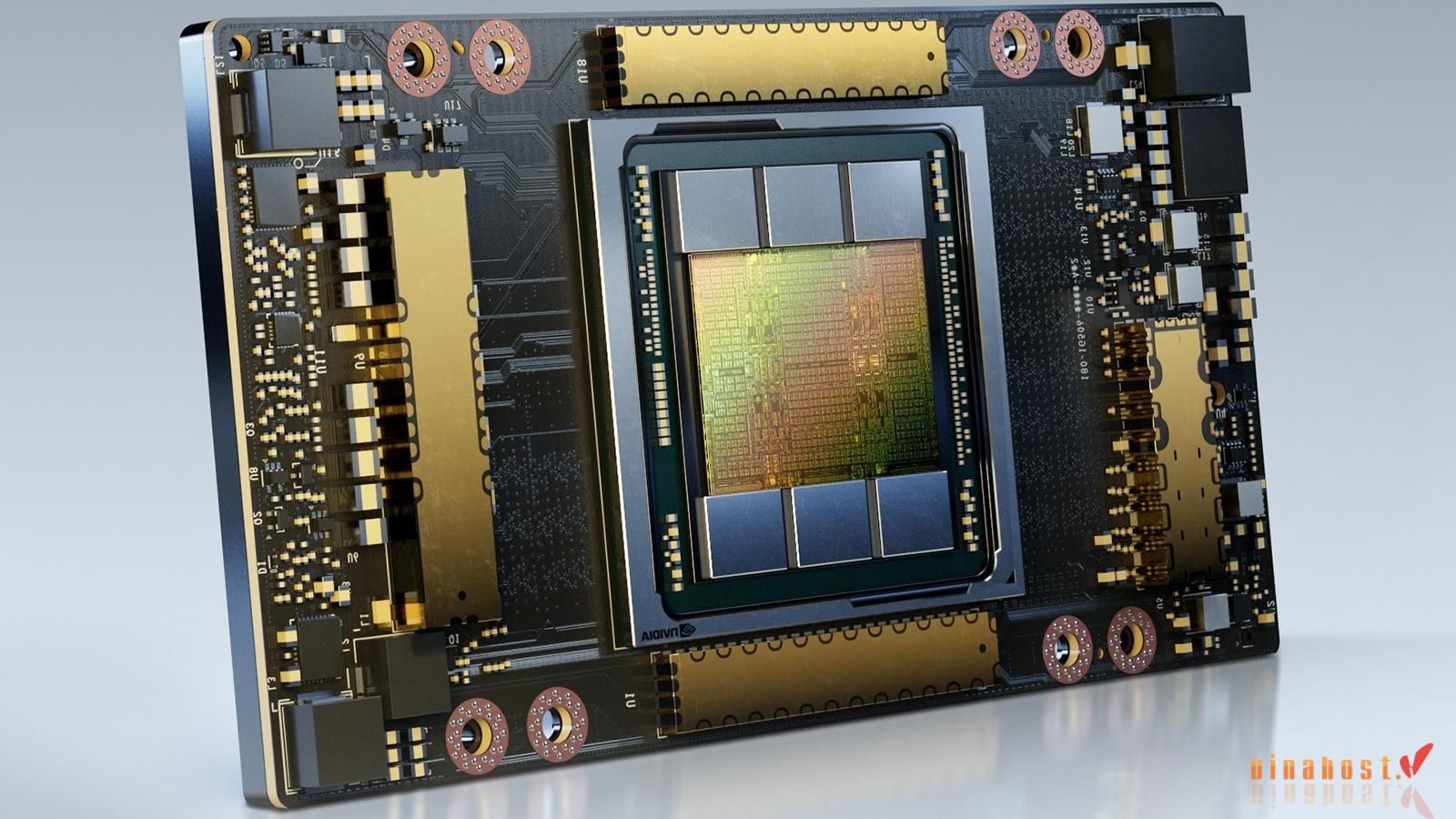

4. Sản phẩm Chủ lực: Hệ thống GB200 NVL72

Trong các hệ thống dựa trên kiến trúc NVIDIA Blackwell, GB200 NVL72 nổi bật như một nền tảng tối ưu cho huấn luyện và suy luận AI ở quy mô trung tâm dữ liệu. Để đạt được hiệu năng đó, GB200 NVL72 được xây dựng trên một cấu hình phần cứng quy mô lớn, tối ưu cho các workload AI và HPC khắt khe nhất.

4.1. Cấu hình GB200 NVL72 Superchip

GB200 NVL72 là hệ thống được thiết kế đặc biệt để đáp ứng nhu cầu tính toán AI khắt khe, bao gồm:

- 72 GPU Blackwell & 36 CPU Grace: Tích hợp sức mạnh xử lý vượt trội, giúp chạy đồng thời các mô hình AI cực lớn và workload HPC khối lượng dữ liệu khổng lồ.

- Thiết kế rack làm mát bằng chất lỏng (liquid-cooled): Giải pháp làm mát tiên tiến giúp kiểm soát nhiệt độ và tối ưu năng lượng, đảm bảo các GPU và CPU hoạt động liên tục mà không giảm hiệu suất.

- Hiệu suất ổn định và đáng tin cậy: Cấu hình này không chỉ mạnh mẽ mà còn cực kỳ ổn định, phù hợp với các môi trường triển khai chuyên nghiệp như trung tâm dữ liệu hoặc các dự án nghiên cứu AI cấp doanh nghiệp.

Với thiết kế này, GB200 NVL72 mang đến trải nghiệm xử lý dữ liệu và AI ở quy mô chưa từng có, đồng thời tối ưu chi phí vận hành nhờ hiệu quả năng lượng vượt trội.

4.2. Khả năng Suy luận (Inference) và Đào tạo (Training)

GB200 NVL72 được tối ưu để thực hiện cả suy luận (inference) lẫn huấn luyện (training) cho các mô hình AI cực lớn, đặc biệt là các mô hình LLM với hàng nghìn tỷ tham số:

- Suy luận (Inference): Hệ thống có thể tăng tốc độ suy luận lên gấp 30 lần so với GPU H100, giúp mô hình trả kết quả nhanh hơn và hiệu quả hơn. Điều này đặc biệt quan trọng với các ứng dụng yêu cầu xử lý thời gian thực như chatbot AI, mô hình ngôn ngữ lớn hoặc AI tạo sinh.

- Huấn luyện AI (Training): GB200 NVL72 tăng tốc độ đào tạo lên gấp 4 lần so với GPU Hopper, rút ngắn đáng kể thời gian phát triển mô hình, cho phép các nhóm nghiên cứu và doanh nghiệp triển khai ứng dụng AI nhanh chóng và hiệu quả.

Nhờ khả năng này, GB200 NVL72 trở thành lựa chọn lý tưởng cho các doanh nghiệp, trung tâm nghiên cứu và các dự án AI quy mô lớn, nơi hiệu suất, tốc độ và độ ổn định là yếu tố quyết định thành công.

4.3. Các Dòng Sản phẩm Khác (DGX Station, DGX Spark)

Ngoài GB200 NVL72, NVIDIA còn phát triển nhiều sản phẩm khác dựa trên kiến trúc NVIDIA Blackwell, phục vụ đa dạng nhu cầu từ doanh nghiệp lớn đến cá nhân:

- DGX Station: Máy tính AI dạng desktop, được thiết kế cho các nhóm nghiên cứu hoặc doanh nghiệp nhỏ. DGX Station mang lại sức mạnh tính toán tương đương trung tâm dữ liệu nhưng ở quy mô nhỏ gọn, thuận tiện triển khai trong văn phòng hoặc phòng thí nghiệm.

- DGX Spark: Máy tính cá nhân dành cho các nhà phát triển và kỹ sư AI, cho phép thử nghiệm, huấn luyện mô hình và phát triển ứng dụng AI ngay trên máy trạm cá nhân, giúp tiết kiệm thời gian và chi phí khi triển khai thử nghiệm.

5. Ưu điểm và Thách thức Triển khai Kiến trúc Blackwell

NVIDIA Blackwell mang lại hiệu năng vượt trội, nhưng đi kèm là những thách thức cần được xem xét khi triển khai ở quy mô lớn.

5.1. Ưu điểm

NVIDIA Blackwell được thiết kế để khai thác tối đa sức mạnh của AI và đồ họa, mang đến các lợi thế nổi bật:

- Hiệu suất tính toán vượt trội: Mỗi chip NVIDIA Blackwell có khả năng đạt tới 20 petaFLOPS, đủ sức xử lý các mô hình AI cực lớn và các workload HPC với khối lượng dữ liệu khổng lồ.

- Tiết kiệm năng lượng: Kiến trúc được tối ưu để cải thiện hiệu quả sử dụng năng lượng, giúp giảm chi phí vận hành mà vẫn đảm bảo hiệu suất cao.

- Khả năng mở rộng mạnh mẽ: NVIDIA Blackwell hỗ trợ các mô hình AI với hàng nghìn tỷ tham số, dễ dàng mở rộng trong các cụm GPU lớn mà không ảnh hưởng đến hiệu suất tổng thể.

- Cải thiện Ray Tracing: Với công nghệ nâng cấp, NVIDIA Blackwell mang lại trải nghiệm đồ họa chất lượng cao, phù hợp cho các ứng dụng hình ảnh, mô phỏng và game.

Nhờ những ưu điểm này, NVIDIA Blackwell trở thành lựa chọn hàng đầu cho các ứng dụng AI, HPC và đồ họa chuyên sâu, giúp doanh nghiệp và trung tâm nghiên cứu đạt hiệu quả tối đa.

5.2. Nhược điểm và Thách thức

Mặc dù sở hữu nhiều ưu thế, việc triển khai NVIDIA Blackwell cũng tồn tại một số hạn chế và thách thức cần lưu ý:

- Chi phí đầu tư cao: Các giải pháp NVIDIA Blackwell, đặc biệt là hệ thống máy chủ, yêu cầu ngân sách đáng kể, phù hợp với doanh nghiệp lớn hoặc trung tâm nghiên cứu có quy mô.

- Yêu cầu tối ưu hóa phần mềm chuyên biệt: Để khai thác toàn bộ hiệu năng, các ứng dụng AI cần được tinh chỉnh riêng cho kiến trúc Blackwell.

- Tiêu thụ điện năng lớn: Trong các cấu hình đa GPU hiệu suất cao, mức điện năng tiêu thụ có thể tăng đáng kể, đòi hỏi hạ tầng điện và làm mát chuyên dụng.

- Khả năng cung ứng hạn chế: Do nhu cầu cao, nguồn cung Blackwell trong giai đoạn đầu có thể bị hạn chế, ảnh hưởng đến việc triển khai nhanh chóng tại một số doanh nghiệp.

Hiểu rõ ưu điểm và thách thức sẽ giúp doanh nghiệp lên kế hoạch triển khai hiệu quả, tận dụng tối đa sức mạnh của NVIDIA Blackwell mà vẫn kiểm soát chi phí và rủi ro.

Câu hỏi Thường Gặp về GPU Blackwell (FAQs)

NVIDIA Blackwell là gì và nó khác gì so với Hopper?

NVIDIA Blackwell là kiến trúc GPU mới nhất của NVIDIA, nổi bật với 208 tỷ transistor và hiệu năng vượt trội. So với Hopper, Blackwell mang lại tốc độ suy luận mô hình LLM nhanh hơn 30 lần, đồng thời cải thiện khả năng mở rộng, hiệu quả năng lượng và hiệu suất xử lý AI.

GPU Blackwell có cần thiết cho chơi game và đồ họa thông thường không?

Không. Mặc dù GPU Blackwell cải thiện hiệu suất Ray Tracing và đồ họa, nó chủ yếu được tối ưu hóa cho AI và tính toán hiệu năng cao (HPC). Do chi phí cao và thiết kế hướng tới các workload chuyên sâu, nó không cần thiết cho người dùng phổ thông hay các tác vụ chơi game và đồ họa thông thường.

Hệ thống GB200 NVL72 có hiệu suất như thế nào đối với LLMs?

Hệ thống GB200 NVL72 mang lại hiệu suất suy luận thời gian thực vượt trội cho các mô hình LLM với hàng nghìn tỷ tham số, nhanh hơn 30 lần so với GPU H100, giúp rút ngắn đáng kể thời gian triển khai và sử dụng mô hình AI quy mô lớn.

Blackwell đảm bảo bảo mật dữ liệu cho các mô hình AI nhạy cảm như thế nào?

Blackwell bảo mật dữ liệu bằng cách tích hợp Confidential Computing và Trusted Execution Environments (TEE), giúp bảo vệ tài sản trí tuệ (IP) và dữ liệu nhạy cảm trong suốt quá trình đào tạo và suy luận của mô hình AI.

NVIDIA Blackwell đánh dấu bước tiến quan trọng trong thiết kế GPU dành cho AI và điện toán hiệu năng cao. Với kiến trúc tối ưu cho các mô hình quy mô lớn cùng khả năng mở rộng mạnh mẽ, Blackwell mang đến nền tảng tính toán đáp ứng nhu cầu AI hiện đại ở cấp độ trung tâm dữ liệu.

Dù yêu cầu hạ tầng và đầu tư phù hợp, Blackwell tiếp tục củng cố vị thế của NVIDIA trong lĩnh vực AI và HPC.

Tham khảo bài viết

Tiếng Việt

Tiếng Việt English

English 简体中文

简体中文