Kiến trúc NVIDIA Hopper đang trở thành nền tảng cốt lõi, cung cấp sức mạnh tính toán vượt trội cho các trung tâm dữ liệu xử lý AI quy mô lớn. Với Transformer Engine, băng thông bộ nhớ cao và khả năng xử lý song song tối ưu, Hopper trở thành nền tảng chủ lực cho huấn luyện LLM, mô phỏng khoa học và Deep learning.

Trong bài viết này, VinaHost sẽ giúp bạn hiểu vì sao Hopper được xem là động lực công nghệ mới của hạ tầng AI toàn cầu.

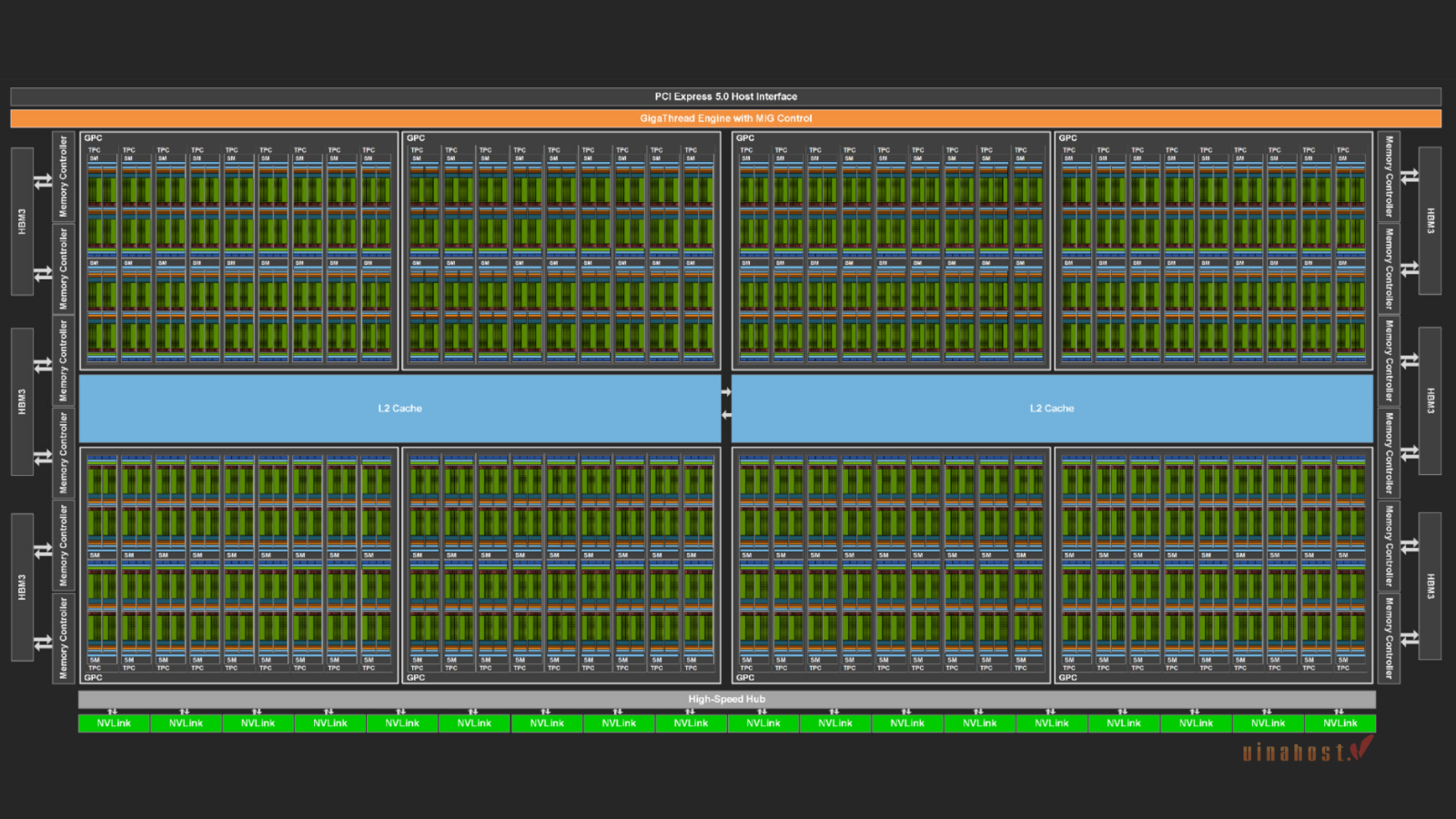

NVIDIA Hopper là kiến trúc GPU thế hệ mới, thiết kế dành riêng cho AI quy mô lớn, HPC và trung tâm dữ liệu hiện đại. Với các công nghệ cốt lõi như Tensor Core thế hệ mới, Transformer Engine, NVLink Gen 4, MIG và Confidential Computing, Hopper mang lại hiệu suất vượt trội và khả năng bảo mật dữ liệu trong suốt quá trình xử lý.

Điểm nổi bật ✅

- Bộ nhớ & Băng thông: H100 trang bị HBM3 80 GB, băng thông ~3,35 TB/s; H200 nâng cấp HBM3e 141 GB, băng thông 4,8 TB/s, phù hợp với workload AI/HPC khổng lồ.

- AI Inference LLM: H200 tăng gấp 2 lần hiệu suất suy luận cho các mô hình như Llama 2-70B và hỗ trợ batch lớn hơn cho LLM/GPT-3.

- HPC & Lập trình động: Lệnh DPX tăng tốc các thuật toán lập trình động, cải thiện hiệu suất HPC lên đến 110 lần so với GPU thế hệ trước.

- Bảo mật & Linh hoạt: Confidential Computing bảo vệ dữ liệu và thuật toán AI; MIG thế hệ 2 chia GPU thành tối đa 7 phiên bản độc lập, tối ưu cho multi-tenant và workload nhỏ.

💡 Hãy đọc tiếp bên dưới để hiểu rõ từng công nghệ, so sánh H100 và H200, và cách tận dụng tối đa sức mạnh của GPU Hopper cho AI và HPC!

1. Tổng quan về Kiến trúc NVIDIA Hopper

Kiến trúc NVIDIA Hopper đánh dấu bước tiến mới trong dòng GPU của NVIDIA, được thiết kế để đáp ứng nhu cầu tính toán AI và trung tâm dữ liệu quy mô lớn. Hopper mở ra khả năng xử lý các mô hình AI khổng lồ với hiệu suất vượt trội, đồng thời tối ưu hóa cho các môi trường tính toán hiện đại.

1.1 Hopper GPU là gì?

Hopper là kiến trúc GPU tiên tiến của NVIDIA, được thiết kế chuyên cho trí tuệ nhân tạo (AI) và tính toán hiệu năng cao (HPC). Dòng GPU này tối ưu cho việc huấn luyện và suy luận các mô hình AI quy mô lớn như LLM, nhờ tích hợp Tensor Core thế hệ mới, Transformer Engine, cùng băng thông bộ nhớ cao, phù hợp cho trung tâm dữ liệu và điện toán đám mây.

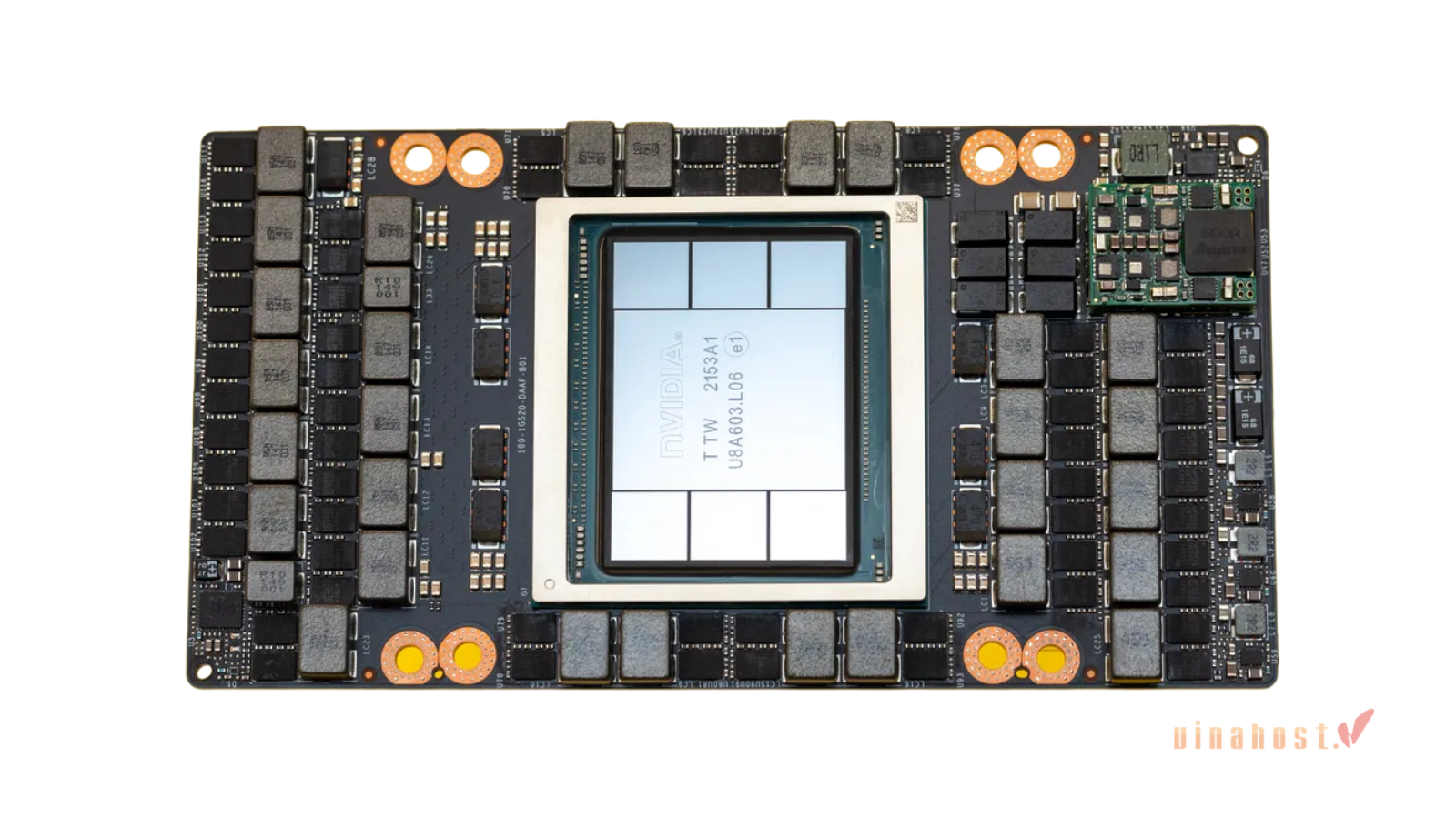

1.2 Quy trình TSMC 4N và 80 Tỷ Transistor

Để đạt hiệu suất và khả năng xử lý song song vượt trội, Hopper GPU được sản xuất trên quy trình TSMC 4nm. Quy trình này giúp GPU tăng hiệu năng, giảm điện năng tiêu thụ và tối ưu hóa khả năng xử lý đồng thời hàng loạt tác vụ phức tạp.

Với thiết kế một GPU Hopper đi kèm hơn 80 tỷ transistor, cao hơn gần 1,5 lần so với GPU tiền nhiệm Ampere A100 (khoảng 54 tỷ transistor). Số lượng transistor khổng lồ này cho phép kiến trúc Hopper triển khai hàng loạt Tensor Core thế hệ mới, hỗ trợ các mô hình AI cực lớn và các ứng dụng HPC phức tạp mà trước đây khó thực hiện.

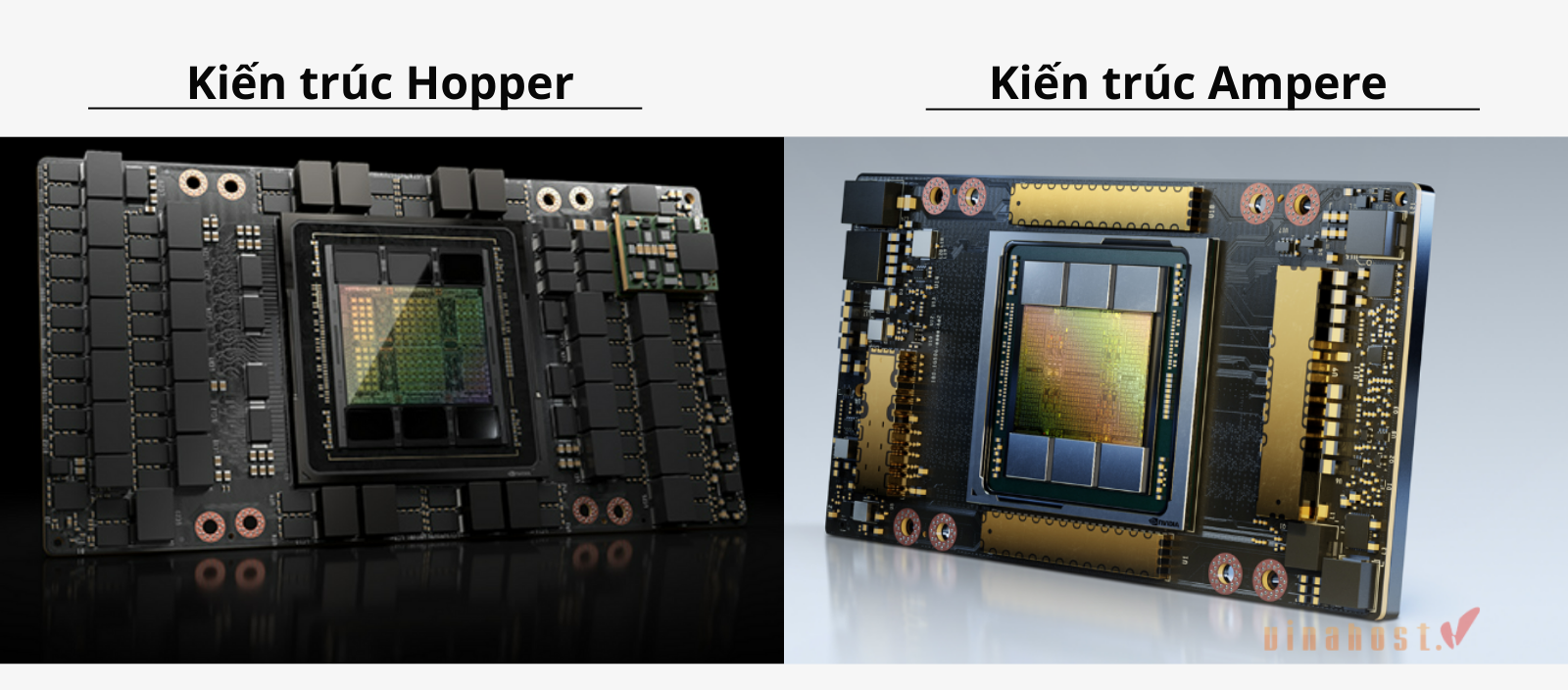

1.3 So sánh Hopper với Kiến trúc Ampere

Hopper và Ampere đều là các kiến trúc GPU quan trọng của NVIDIA, nhưng được thiết kế với mục tiêu và khả năng khác nhau.

Dưới đây là bảng so sánh giữa Hopper và Ampere, giúp bạn dễ nắm bắt điểm khác biệt

| Tiêu chí | NVIDIA Hopper | NVIDIA Ampere |

| Quy trình sản xuất | Quy trình TSMC 4N | Quy trình 7nm |

| Số transistor | Hơn 80 tỷ transistor | Khoảng 54 tỷ transistor |

| Tensor Core & AI | Tensor Core thế hệ mới + Transformer Engine → tối ưu huấn luyện & inference LLM | Tensor Core thế hệ trước, không có Transformer Engine |

| Hiệu năng AI / HPC | Cao hơn đáng kể, xử lý mô hình AI quy mô khổng lồ | Hiệu năng tốt, nhưng giới hạn với các mô hình AI cực lớn |

| Bộ nhớ | HBM3 tốc độ cao, băng thông lớn, giảm nghẽn dữ liệu, hỗ trợ khối lượng dữ liệu AI khổng lồ. | HBM2e, băng thông thấp hơn, giới hạn khi xử lý dữ liệu quy mô lớn. |

| MIG | Hỗ trợ nhiều instance hơn, hiệu suất mỗi instance cao | Hỗ trợ MIG nhưng số lượng instance và hiệu suất thấp hơn |

| Mục tiêu sử dụng | AI quy mô lớn, HPC, trung tâm dữ liệu và đám mây | HPC, AI trung bình, datacenter trước Hopper |

Tóm lại, so với Ampere, Hopper mạnh hơn về hiệu suất tính toán, tối ưu AI với Transformer Engine, khả năng mở rộng trung tâm dữ liệu tốt hơn, đồng thời hỗ trợ các mô hình AI quy mô khổng lồ mà Ampere khó đạt được. Đây là lý do kiến trúc Hopper được xem là bước tiến quan trọng trong dòng máy chủ GPU datacenter của NVIDIA.

2. Kỹ thuật Cốt lõi của Nền tảng GPU Hopper

Không chỉ nâng cấp về phần cứng, kiến trúc Hopper còn tích hợp những công nghệ cốt lõi tiên tiến dưới đây.

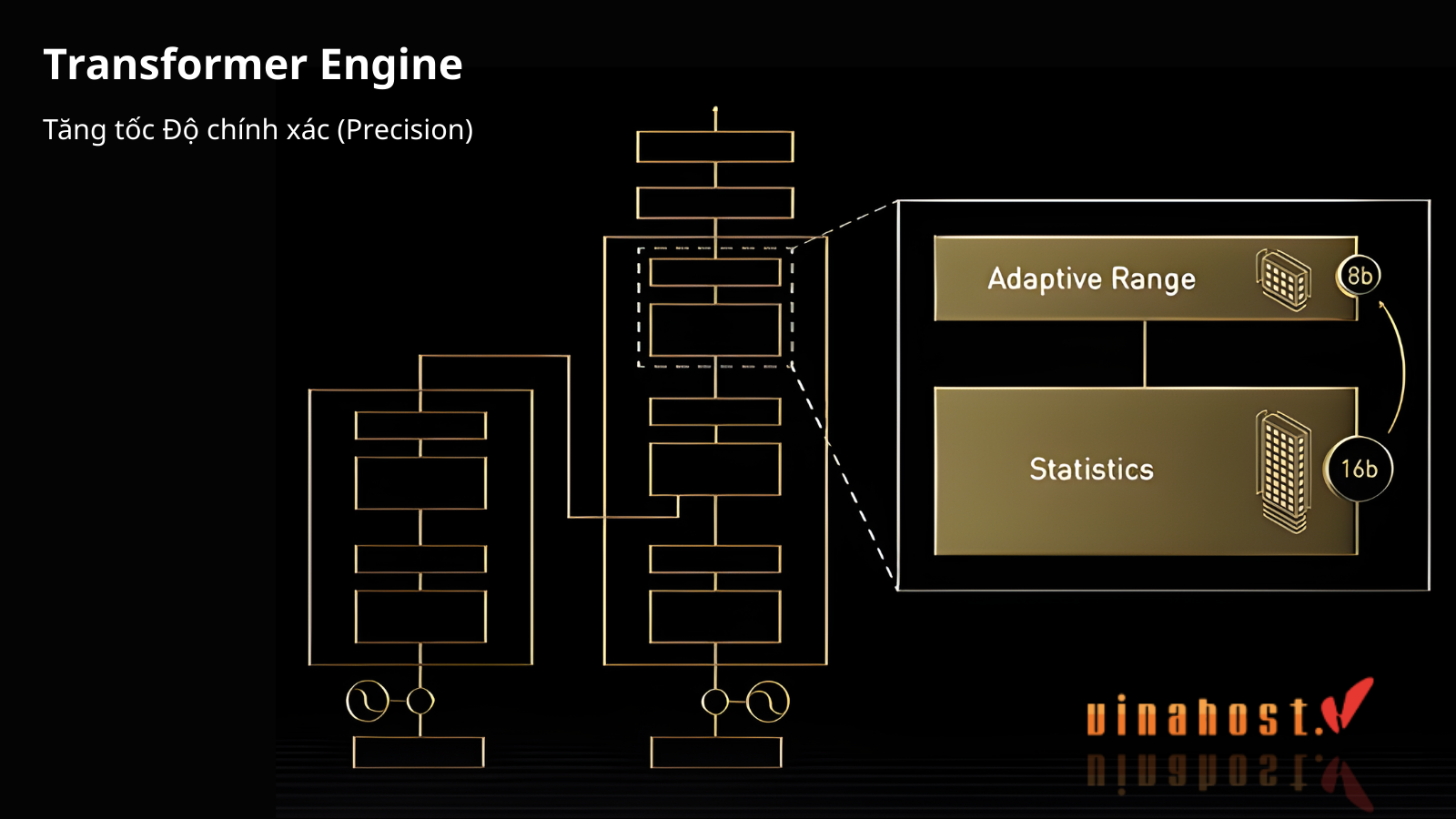

2.1. Transformer Engine: Tăng tốc Độ chính xác (Precision)

Transformer Engine giúp tăng tốc quá trình huấn luyện các mô hình AI, đặc biệt là mô hình Transformer và LLM. Các điểm chính:

- Sử dụng độ chính xác hỗn hợp FP8 và FP16 để tối ưu hiệu suất tính toán.

- Tăng tốc huấn luyện AI nhưng vẫn giữ độ chính xác cần thiết cho các mô hình lớn.

- Hỗ trợ các định dạng tính toán phổ biến như TF32, FP64, FP16 và INT8.

- Tăng số phép tính FLOPS trên GPU, giúp cải thiện hiệu suất tổng thể.

- Có thể tăng tốc huấn luyện AI lên tới 9 lần so với các GPU thế hệ trước.

- Hoạt động kết hợp với Tensor Core và NVLink Gen4 để xử lý dữ liệu nhanh hơn trong các hệ thống AI và HPC quy mô lớn.

2.2. Giao tiếp GPU Siêu tốc với NVLink Switch System Gen 4

Để huấn luyện các mô hình AI quy mô lớn hoặc xử lý workload HPC, nhiều GPU cần hoạt động cùng lúc. Vì vậy, tốc độ truyền dữ liệu giữa các GPU trở thành yếu tố quan trọng quyết định hiệu suất của toàn hệ thống. Hệ sinh thái Hopper giải quyết vấn đề này bằng NVLink Gen 4 và NVSwitch.

NVLink Gen 4 – Kết nối tốc độ cao giữa các GPU

- Là công nghệ kết nối trực tiếp GPU với GPU của NVIDIA.

- Cung cấp băng thông hai chiều lên tới 900 GB/s trên mỗi GPU.

- Nhanh hơn khoảng 7 lần so với PCIe Gen5.

- Giúp các GPU trao đổi dữ liệu liên tục mà không bị nghẽn cổ chai khi huấn luyện mô hình AI lớn.

NVSwitch – Mở rộng kết nối GPU ở quy mô lớn

- Là bộ chuyển mạch (switch) cho phép nhiều GPU kết nối với nhau trong cùng hệ thống.

- NVSwitch thế hệ 3 có thể mở rộng cụm lên tới 256 GPU.

- Hỗ trợ giao thức SHARP để tối ưu việc tổng hợp và giảm dữ liệu trong quá trình tính toán.

- Giúp tăng gấp đôi thông lượng giảm dữ liệu so với hệ thống GPU Ampere A100 trước đây.

Khi kết hợp NVLink và NVSwitch:

- Các hệ thống như DGX GH200 có thể đạt tổng băng thông lên tới 57,6 TB/s.

- Toàn bộ cụm GPU hoạt động như một hệ thống tính toán thống nhất, tối ưu cho AI và HPC quy mô lớn.

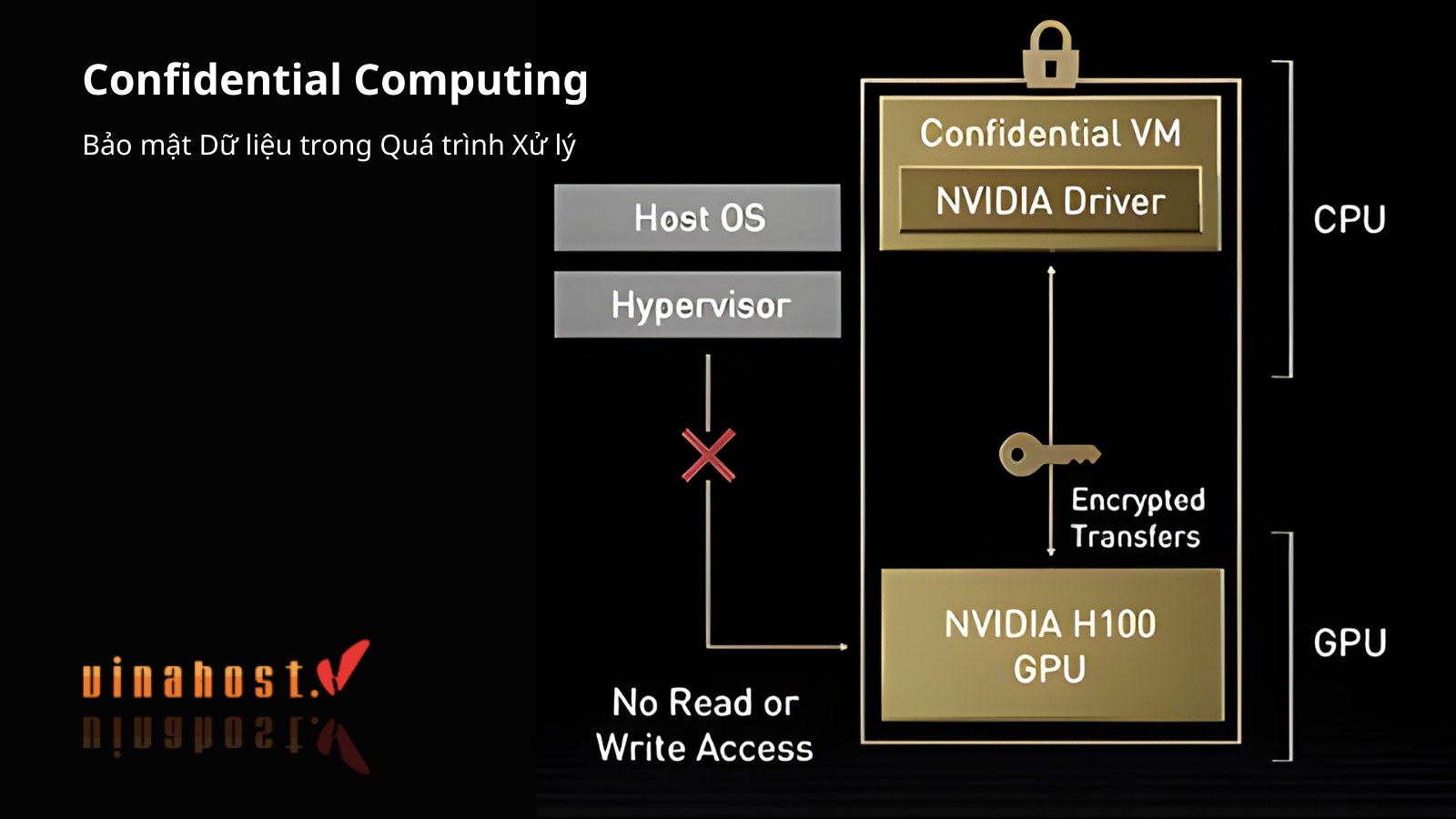

2.3. Confidential Computing: Bảo mật Dữ liệu trong Quá trình Xử lý

Thông thường, dữ liệu được mã hóa khi lưu trữ hoặc truyền qua mạng, nhưng lại ít được bảo vệ khi đang được xử lý trong bộ nhớ của CPU hoặc GPU. Confidential Computing trên kiến trúc Hopper được thiết kế để khắc phục điểm yếu này bằng cách bảo vệ dữ liệu ngay trong quá trình tính toán.

Một số đặc điểm của Confidential Computing trên Hopper:

- Tạo vùng thực thi an toàn (secure execution environment) cho dữ liệu và mã ứng dụng khi GPU xử lý.

- Dữ liệu được bảo vệ ngay cả trong bộ nhớ và trong lúc đang tính toán.

- Giúp ngăn truy cập trái phép từ hệ thống hoặc các tiến trình khác.

- Đảm bảo tính bảo mật và toàn vẹn của dữ liệu cũng như mô hình AI.

- Phù hợp với các workload cần mức bảo mật cao như AI, dữ liệu tài chính hoặc dữ liệu nhạy cảm trên cloud.

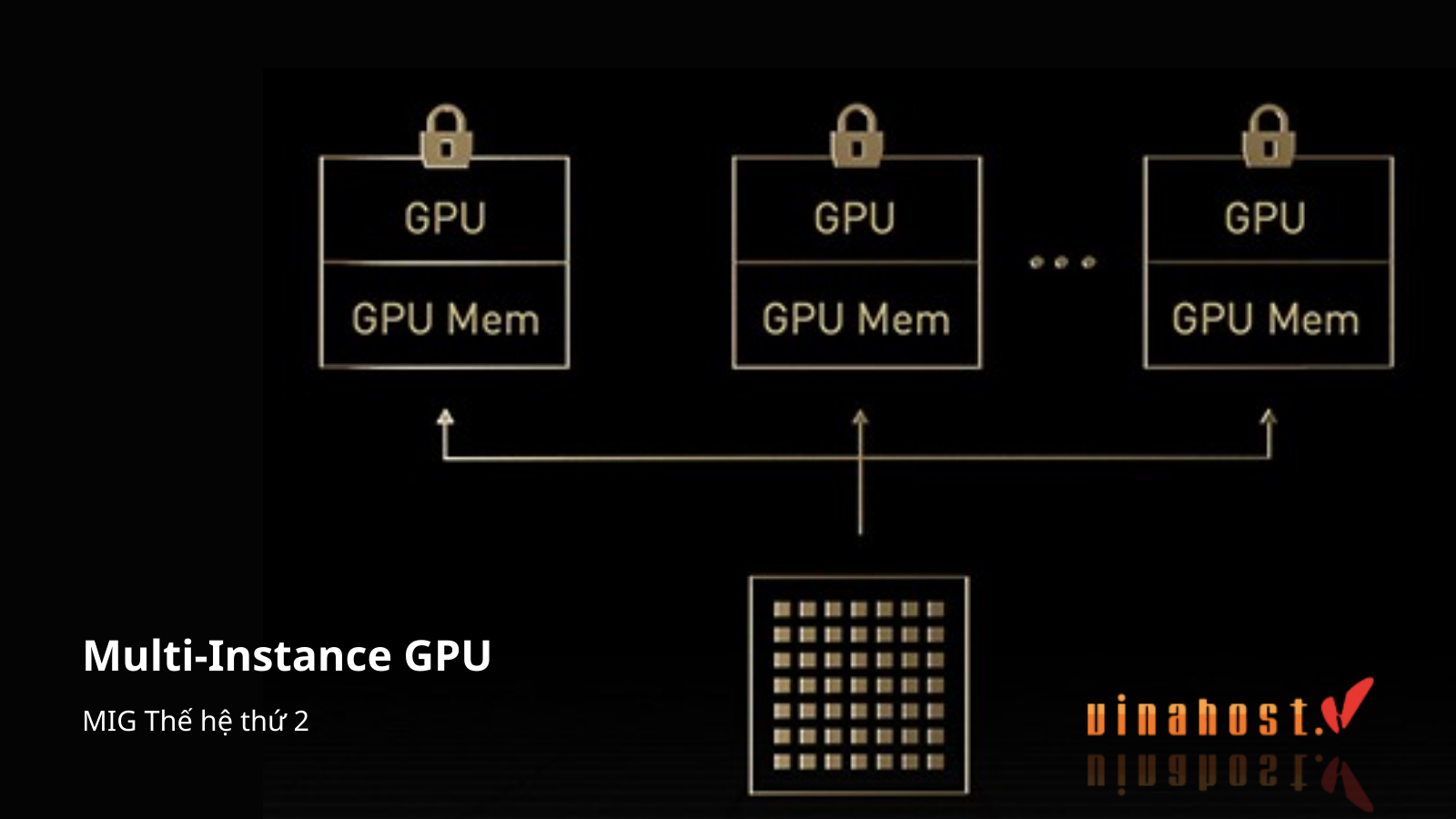

2.4. Multi-Instance GPU (MIG) Thế hệ thứ 2

Multi-Instance GPU (MIG) là công nghệ cho phép chia một GPU vật lý thành nhiều GPU nhỏ hoạt động độc lập. Trên kiến trúc Hopper, MIG được nâng cấp để hỗ trợ tốt hơn cho các môi trường nhiều người dùng và nhiều workload chạy đồng thời.

Một số đặc điểm của MIG trên Hopper:

- Có thể chia một GPU thành tối đa 7 instance độc lập.

- Mỗi instance có bộ nhớ, cache và tài nguyên tính toán riêng.

- Các instance được cách ly ở mức phần cứng, giúp tăng tính bảo mật và ổn định.

- Cho phép nhiều ứng dụng hoặc người dùng sử dụng cùng một GPU mà không ảnh hưởng lẫn nhau.

- Phù hợp với môi trường ảo hóa, cloud và trung tâm dữ liệu cần chạy nhiều workload cùng lúc.

2.5. Lệnh DPX Instructions: Tăng tốc Lập trình Động

DPX Instructions là tập lệnh mới được NVIDIA bổ sung trong kiến trúc Hopper nhằm tăng tốc các thuật toán lập trình động (Dynamic Programming). Đây là kỹ thuật thường dùng để giải các bài toán tối ưu phức tạp bằng cách chia chúng thành nhiều bài toán nhỏ và lưu lại kết quả trung gian để tránh tính toán lặp lại.

ℹ️ Các thuật toán dạng này xuất hiện trong nhiều lĩnh vực như sinh học tính toán, xử lý đồ thị, tối ưu hóa mạng và HPC.

Những điểm chính của DPX Instructions:

- Được thiết kế để tăng tốc các phép toán phổ biến trong thuật toán lập trình động.

- Giúp xử lý nhanh hơn các bài toán như:

- Căn chỉnh chuỗi DNA (Smith-Waterman)

- Tối ưu hóa tuyến đường (Floyd-Warshall)

- Xử lý đồ thị và phân tích mạng

- Có thể tăng tốc tới ~7 lần so với GPU Ampere trong các workload tương tự.

- Trong một số trường hợp, hiệu năng có thể nhanh hơn tới 40 lần so với máy chủ CPU hai socket.

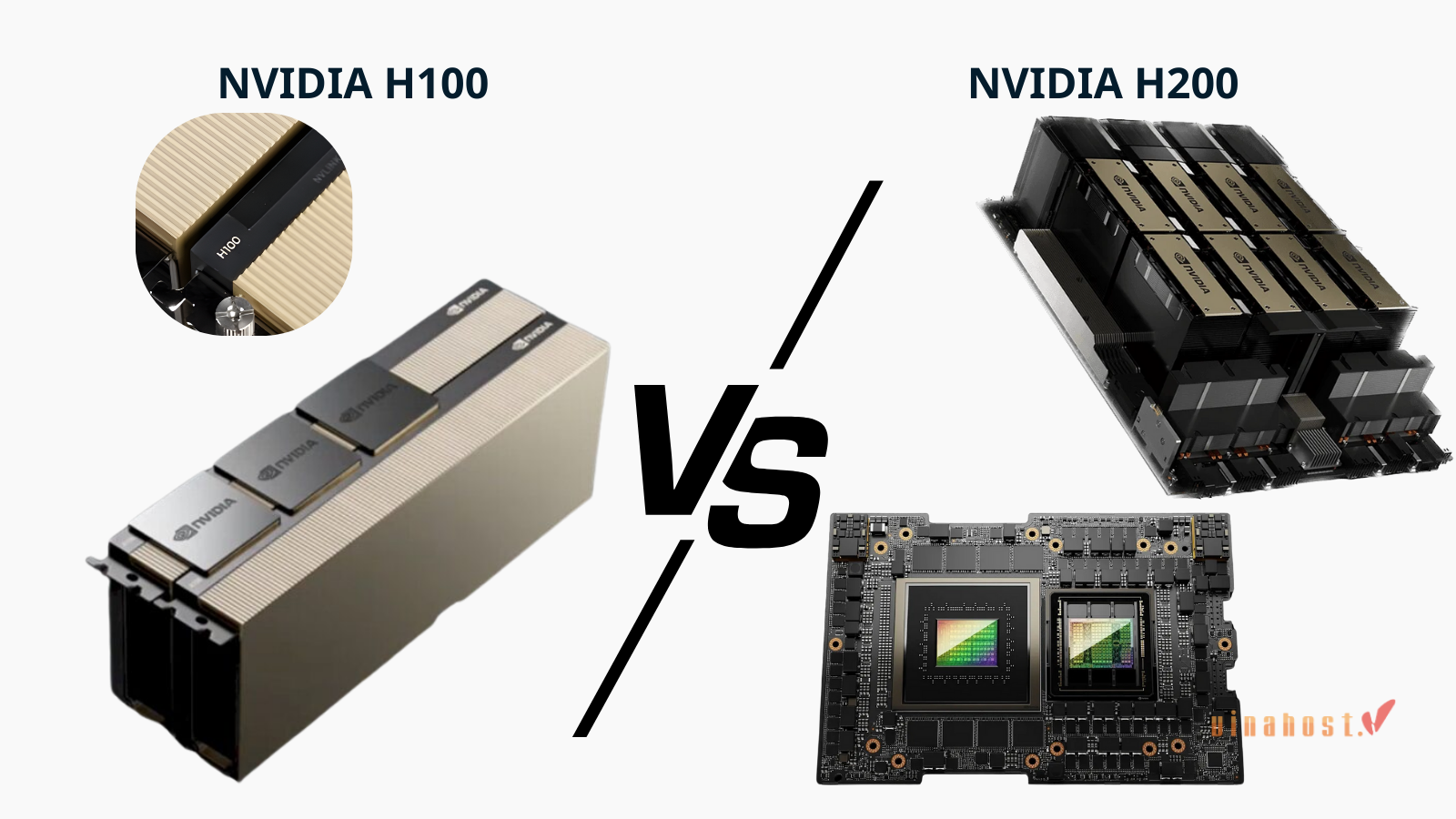

3. So sánh cấu hình dòng GPU Hopper: H100 với H200

Để thấy rõ sức mạnh và khả năng xử lý vượt trội của dòng GPU Hopper, hãy so sánh hai phiên bản tiêu biểu: H100 và H200.

| Tiêu chí | NVIDIA H100 | NVIDIA H200 |

| Bộ nhớ | HBM3, tối đa 80 GB | HBM3e, tối đa 141 GB |

| Băng thông | 3.35 TB/s | 4,8 TB/s |

| Hiệu suất AI Inference (LLM) | Đáp ứng tốt LLM cỡ trung bình | Gấp 2 lần H100, hỗ trợ batch size lớn hơn cho Llama 2 (70B) và GPT-3 |

| Hiệu suất HPC | Lựa chọn đáng tin cậy cho HPC truyền thống | Hiệu suất HPC cao hơn tới 110 lần so với GPU thế hệ trước |

| Ứng dụng phù hợp | Workload AI và HPC vừa và nhỏ | Workload AI và HPC quy mô lớn, mô phỏng khoa học phức tạp |

Bảng so sánh H100 vs H200

So với GPU Hopper H100, GPU Hopper H200 không chỉ cải thiện tốc độ tính toán mà còn giúp các nhà nghiên cứu và doanh nghiệp thực hiện những mô phỏng phức tạp, phân tích dữ liệu lớn và các bài toán khoa học quy mô cực lớn nhanh hơn, hiệu quả hơn.

4. Các trường hợp nên sử dụng công nghệ Hopper

4.1. Ứng dụng AI và Deep Learning

Hopper còn hỗ trợ các tác vụ chuyên sâu như phân tích hình ảnh, nhận dạng giọng nói, phân loại văn bản và dự đoán hành vi, nhờ vào khả năng xử lý dữ liệu nhanh chóng và băng thông bộ nhớ cao. Đặc biệt là khi làm việc với các mô hình quy mô lớn như LLM (Large Language Model), mạng neural phức tạp và các hệ thống học tăng cường.

4.2. Ứng dụng Phân tích Dữ liệu và Khoa học

Nhờ khả năng tính toán mạnh mẽ và bộ nhớ HBM3/HBM3e tốc độ cao, Multi-Instance GPU (MIG) và NVLink thế hệ mới. Điều này giúp các nhóm nghiên cứu và doanh nghiệp tối ưu hóa tài nguyên, giảm chi phí và tăng tốc thời gian phân tích, từ đó rút ngắn đáng kể chu kỳ nghiên cứu và phát triển.

4.3. Triển khai trong Hệ thống AI Supercloud và HGX

Hệ thống HGX với GPU Hopper cho phép triển khai các giải pháp đám mây AI đa người dùng một cách linh hoạt, đồng thời đảm bảo khả năng chia GPU an toàn bằng MIG, tối ưu hóa hiệu quả sử dụng tài nguyên và bảo vệ dữ liệu nhạy cảm.

Nhờ những cải tiến này, các doanh nghiệp và trung tâm dữ liệu có thể triển khai Supercloud AI mạnh mẽ, mở rộng nhanh chóng và tối ưu chi phí, đáp ứng nhu cầu học máy, phân tích dữ liệu và mô phỏng khoa học ở quy mô cực lớn.

Câu hỏi Thường Gặp về Nền tảng Hopper

1. NVLink Switch System trong kiến trúc Hopper có vai trò gì?

NVLink Switch System giúp kết nối nhiều GPU Hopper liền mạch, đạt băng thông cực cao, hỗ trợ cụm lên đến hàng trăm GPU và tối ưu hóa hiệu suất cho các workload AI và HPC quy mô lớn.

2. Sự khác biệt chính giữa NVIDIA H100 HGX và H200 HGX là gì?

H200 HGX nâng cấp so với H100 HGX với bộ nhớ lớn hơn (HBM3e 141 GB so với HBM3 80 GB), băng thông cao hơn (4,8 TB/s so với 3,35 TB/s) và hiệu năng AI/HPC cải thiện đáng kể, đặc biệt cho các mô hình LLM và workload quy mô lớn

3. Có thể sử dụng Hopper GPU cho các tác vụ chơi game và đồ họa thông thường không?

Có thể sử dụng, nhưng Hopper được thiết kế tối ưu cho AI, HPC và trung tâm dữ liệu; hiệu năng cho chơi game hoặc đồ họa thông thường không tối ưu và chi phí cao so với GPU chuyên dụng cho gaming

4. Overclocking CPU hay GPU, thành phần nào quan trọng hơn để tăng FPS?

Để tăng FPS, GPU thường quan trọng hơn vì hầu hết hiệu năng đồ họa phụ thuộc vào khả năng xử lý hình ảnh của GPU. CPU cũng ảnh hưởng, nhưng chủ yếu khi trò chơi có nhiều logic, AI hoặc vật lý cần tính toán; do đó, cân bằng giữa CPU và GPU mới mang lại hiệu suất tối ưu.

Kiến trúc NVIDIA Hopper không chỉ là bước tiến vượt trội trong lĩnh vực GPU mà còn mở ra khả năng xử lý AI và HPC quy mô khổng lồ. Từ Tensor Core thế hệ mới, Transformer Engine, NVLink, MIG đến Confidential Computing, Hopper cung cấp một nền tảng mạnh mẽ, linh hoạt và bảo mật cho các trung tâm dữ liệu hiện đại.

Dù bạn là nhà nghiên cứu, doanh nghiệp hay nhà phát triển AI, việc hiểu rõ các phiên bản H100 và H200 và cách ứng dụng chúng sẽ giúp tối ưu hóa hiệu năng, tiết kiệm thời gian và tài nguyên, đồng thời mở rộng khả năng triển khai các workload phức tạp.

Tiếng Việt

Tiếng Việt English

English 简体中文

简体中文